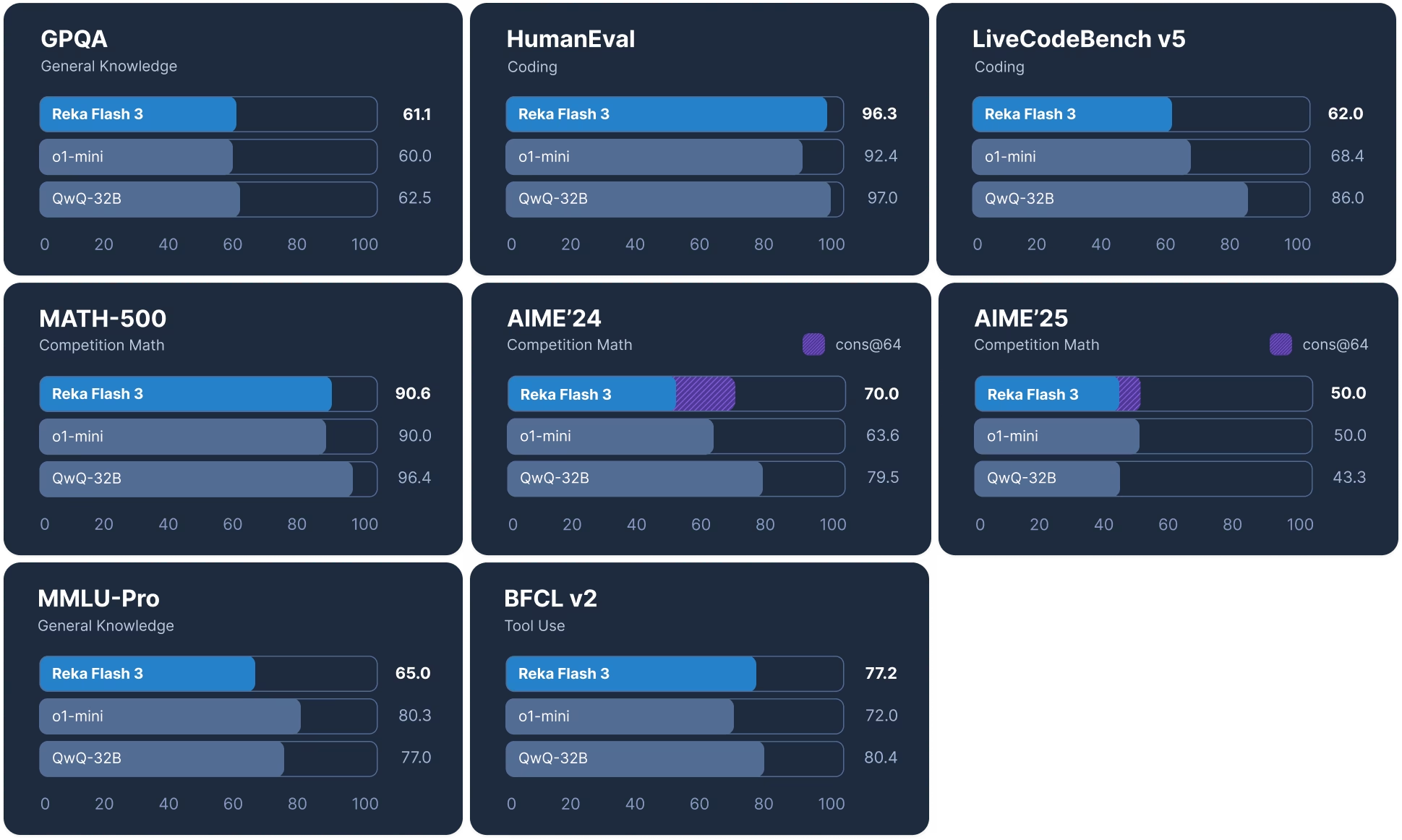

RekaAI 刚发布了一个20.9B大小的模型,宣称性能接近 Qwen-QwQ-32B。

具体分数如图。注意AIME’24/25 数学测试那个紫色的cons@ 64 结果指的是,prompt 运行了64次,至少有一次回答正确的意思。

模型地址:huggingface.co/RekaAI/reka-flash-3

3

主要是给16g显存的用户更多选择,但相比DeepSeek-R1-Distill-Qwen-14B只有代码能力有明显优势

我觉得LLM跑分跑5-shot就已经够离谱的,原来还有更离谱的

笑死。我建议我的数学老师也给我选择题64次机会,我肯定能考满分 😂