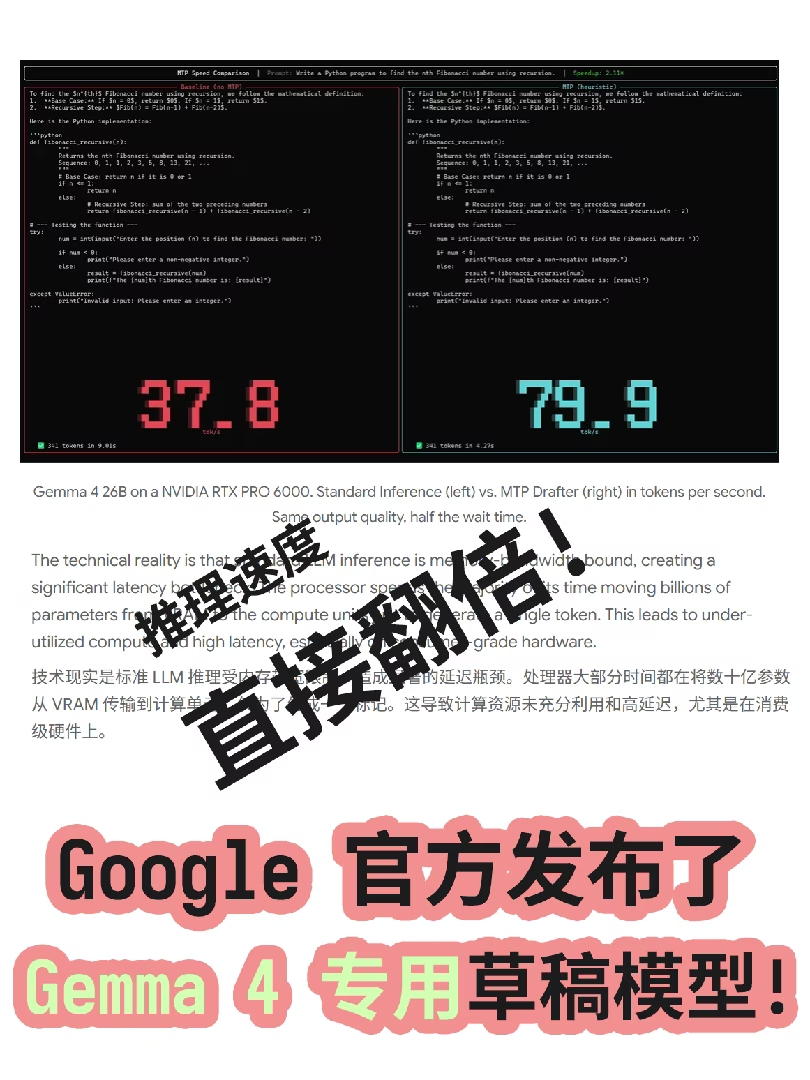

Google 刚刚发布了 Gemma 4系列模型的草稿专用模型! 31B Dense 搭配草稿模型速度竟然能提升3倍! 付出的代价仅仅是多花 1G 显存!

相信大家都对此前notepad++的开发者声称用户如不赞成某种政治倾向则会随机修改用户文档的事情有所耳闻。在此推荐一个轻量化的文字编辑器,可供替换notepad++使用。

https://gitee.com/cxasm/notepad--

给nas升级,入个二手华硕Z10PA-U8主板,单路C612。因为官方BIOS没有提供对PCIe通道拆分,从网上寻摸了个支持拆分的mod版BIOS,DOS下无论是华硕官方的BUPDATER还是AFUDOS都无法刷上,根据提示搜索发现是BIOS有写保护,而BIOS里没有选项关闭写保护。 在网上看解决办法都比较模糊,在此问问各位有无简单直接点的办法,比如去淘宝买个烧录好的BIOS芯片?

原有光猫是H5-9,逛闲鱼发现有一款支持2.5G光猫(25元还包邮)中国移动HX5-9saLite XG-PON,下行1个2.5G+3个1G电口 换上改好桥接连接光纤后注册成功,笔记本2.5G网卡拨号连接测速800多Mbps,和之前H5-9速度差不多。 有帖子说需要联系运维后台刷新一下速度才能上去,有大佬知道是啥问题吗?

获取超级管理员密码原帖:https://www.bilibili.com/opus/1023045498940948547 1.光猫开启telnet 打开http://192.168.1.1/usr=CMCCAdmin&psw=aDm8H%25MdA&cmd=1&telnet.gch 或http://192.168.1.1/getpage.gch?pid=1002&nextpage=tele_sec_tserver_t.gch开启光猫telnet功能,页面提示“TelnetSet Success!”表示开启成功…

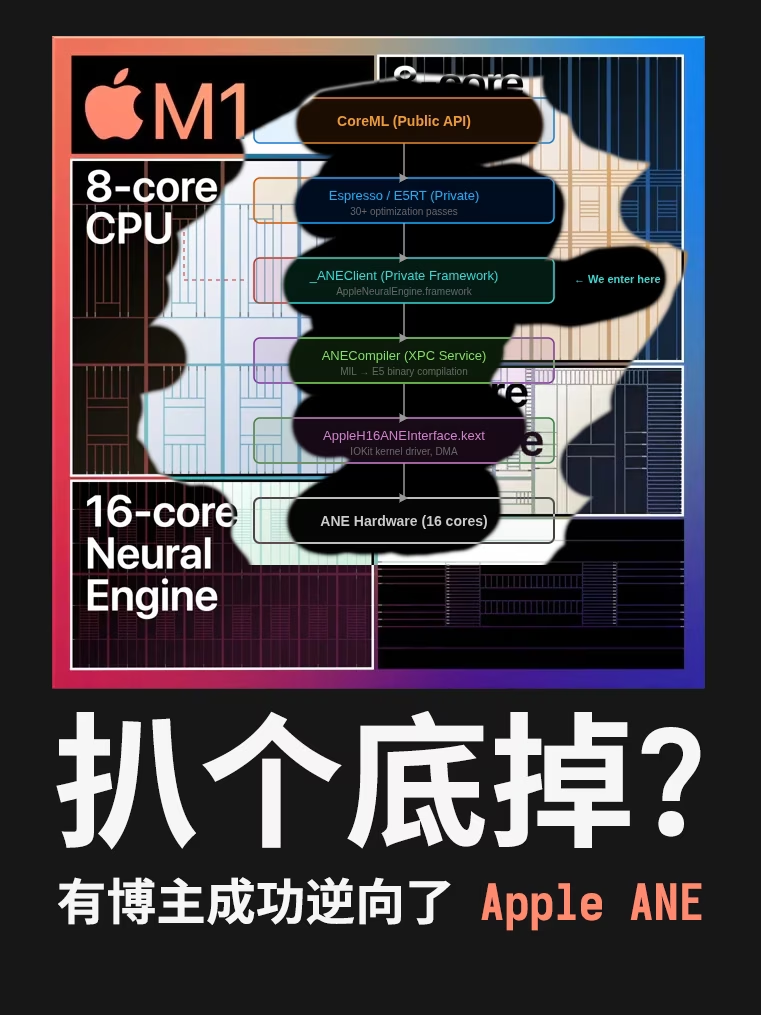

刚刷到博主 maderix 开源了个硬核项目: 逆向 Apple 的私有 API, 绕过 CoreML, 直接在 Apple Neural Engine (ANE) 上实现了神经网络训练!

前几日我正为Xeon max的板子而发愁,Intel并没有在ArcherCity上对Xeon max进行太多测试,这导致手头上的Archercity(ARC关联Hikari的https://cyberbus.net/post/558)似乎看起来点不亮Xeon max——上电不启动甚至CPU不发热——这是很明显的me阻断现象,与此同时在朋友的技嘉MS03-CE0上,Max的点亮似乎并不困难——只需要简单的更改一些BIOS选项,Max便可以稳定的在MS03上跑的很欢——显而易见我没有能力绕过me阻断去解除,ARC看起来最好的搭档还是普通Xeon和DCPMM 300系列了。

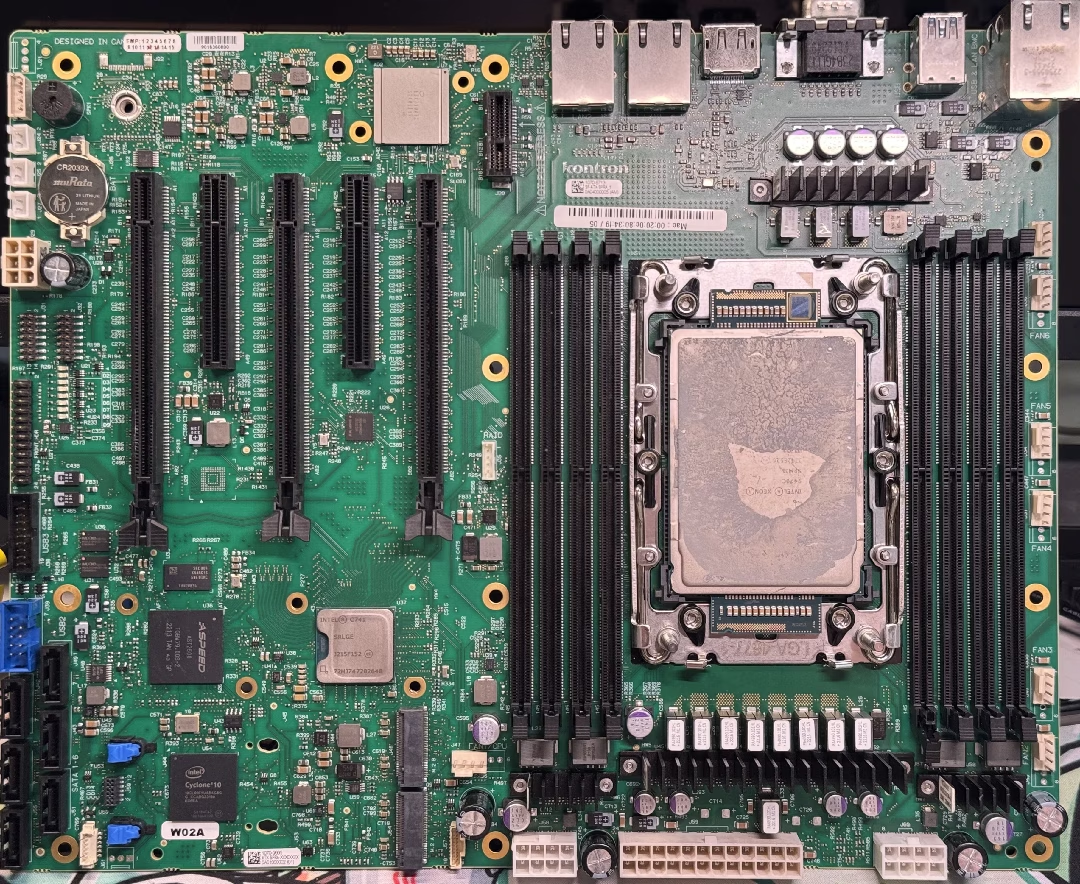

当我试图上网冲浪找找有没有大怨种因为在内存涨价前买了MS03但没买内存导致被迫低价出MS03时,恰巧逛到了这块板子,只一眼便感觉此刻便是All in的时机,无论是后置IO还是PCIe布局,都是我非常中意的那种,在查询Kontron官网后,发现K9051 Support List里面SPR的Xeon Max赫然在列,于是顺利买下。

到手的那一刻,心里不免凉了半截,这个主板上有部分焊油,分明是仓库库存的返修良品!所幸焊油不多,很容易清理干净。

前言

同步发布于 我的Gist

这篇文初稿写于2025年3月,之前本来计划写好了直接发出来的,兜兜转转一直咕了,最近准备对这套配置做个升级,现在再不发出来就晚了。

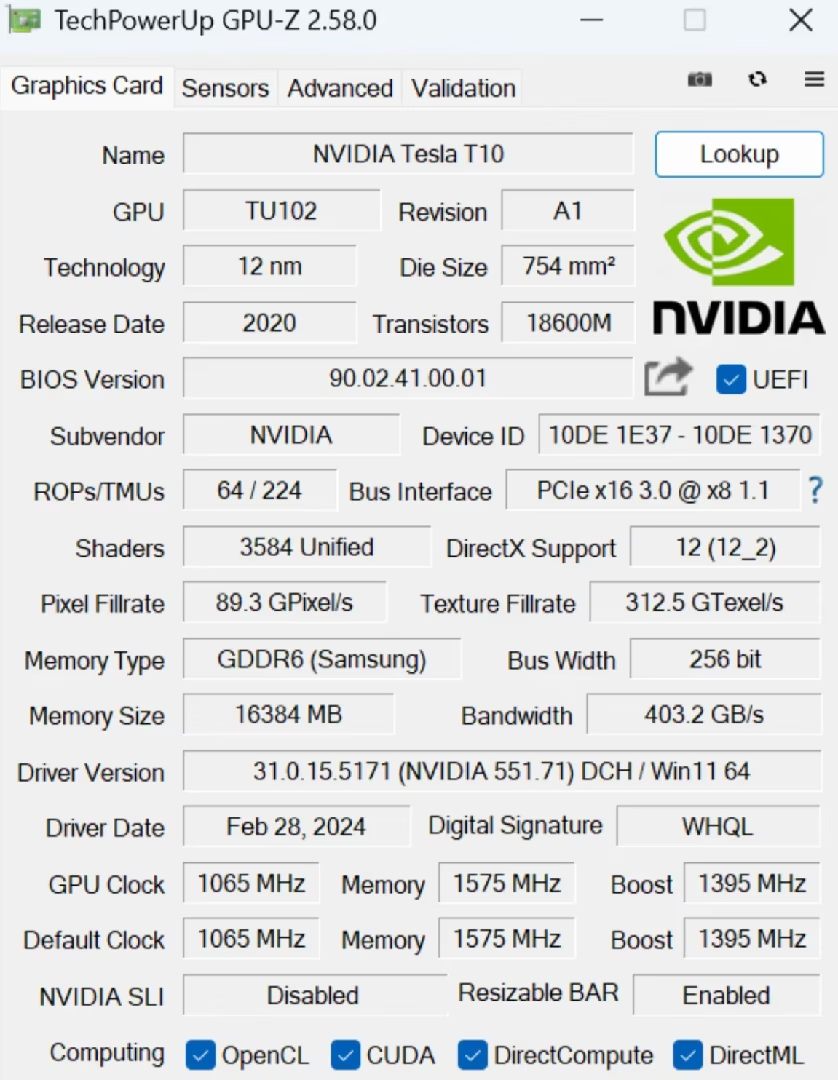

现在来看,选T10性价比其实已经不是那么高,当时做这个配置的时候 2080ti 22G还要2200一块,现在已经跌到1700左右了,T10现在还在1000出头。 2080ti算力更高的同时还支持NVLink,4卡互联应该可以跑起来社区最近比较火的 MiniMax-M2.1-REAP W4A16。…

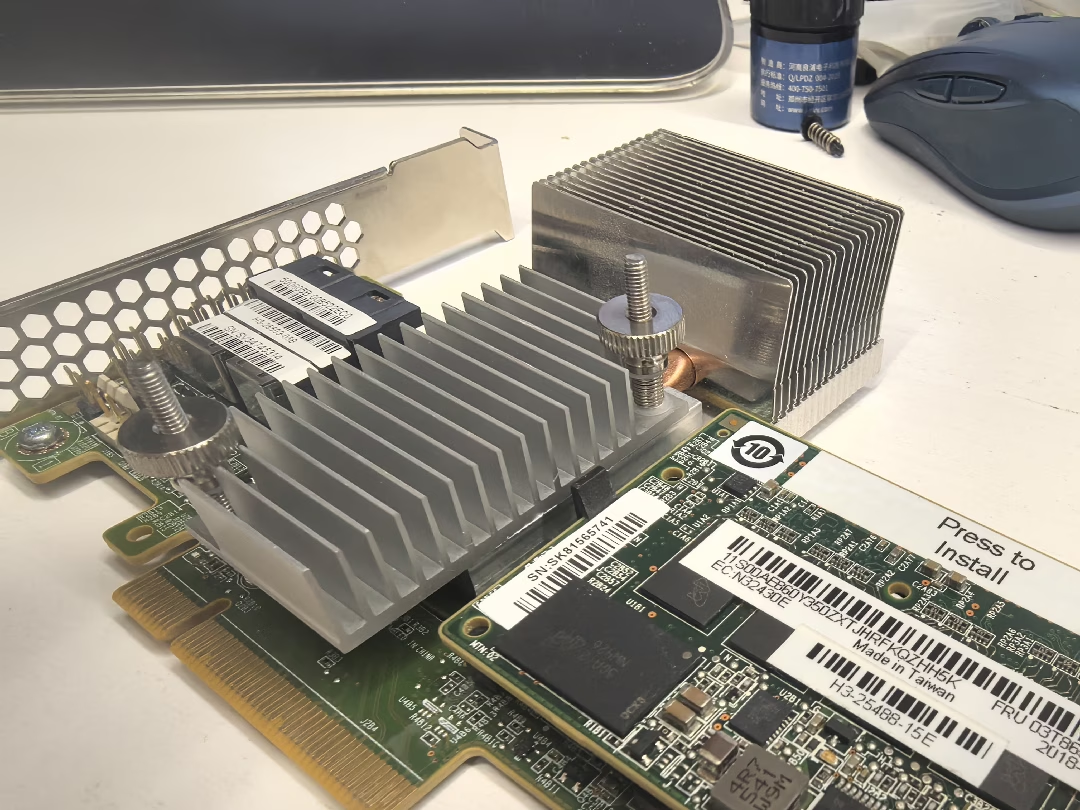

9364-8i是最后一代支持CacheCade Pro的卡,对机械盘相对友好,价格便宜,量大管饱,所以一直坚守在岗位上,只是散热太弱了,我用服务器机箱暴力风扇要开全速才能压的住(就这还要有56度),风速降点速就直接热的挂机,能热到85度以上。

改造散热后,环境温度21度下,同样的机箱风速自动,保持在49度,全速在38度。效果十分明显。

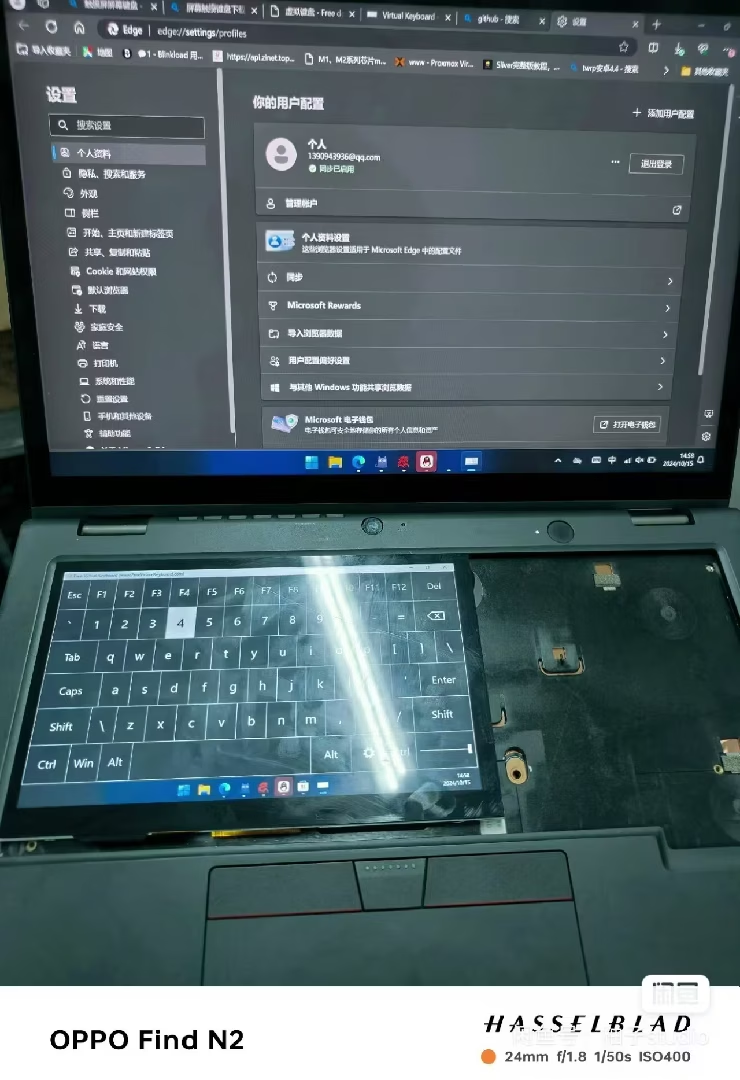

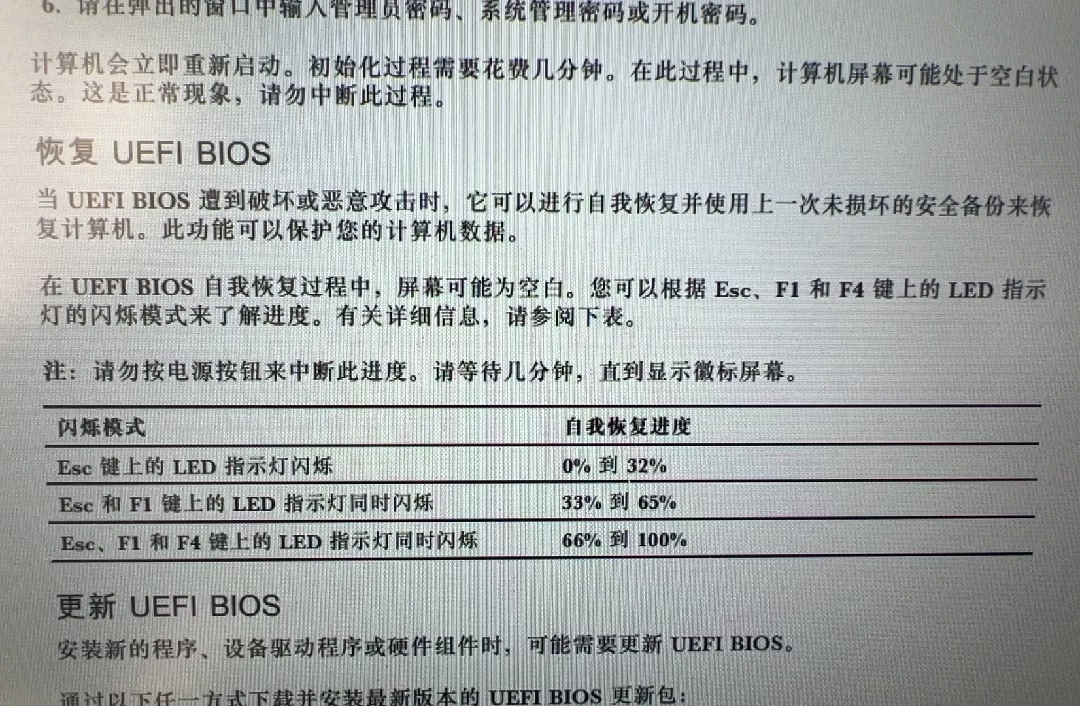

Thinkpad X1 Carbon Gen10不开机键盘指示灯ESC F1 F4依次闪烁 早上开机后突然蓝屏,蓝屏按照提示按回车后正常开机并进入系统。登录企微后又突然蓝屏,进入安全模式失败,通过移动硬盘用Ventry进入U盘启动也蓝屏。按照必应搜索建议捅了D壳重置后开机进入修复也失败,现在显示屏无显示,按开机键后三个按键知识点依次闪烁,官方文档说bios在修复一个多小时了状态还没变。有什么解决办法吗?这样会影响数据吗?

小公司,有一个移动专线套餐,是pppoe+一个固定ipv4, 内网只有办公网络和测软硬件用的esxi,偶尔会用到端口转发把测试环境的端口映射到固定ip上。

目前是把固定v4挂到了usg6307上,pppoe闲置了。

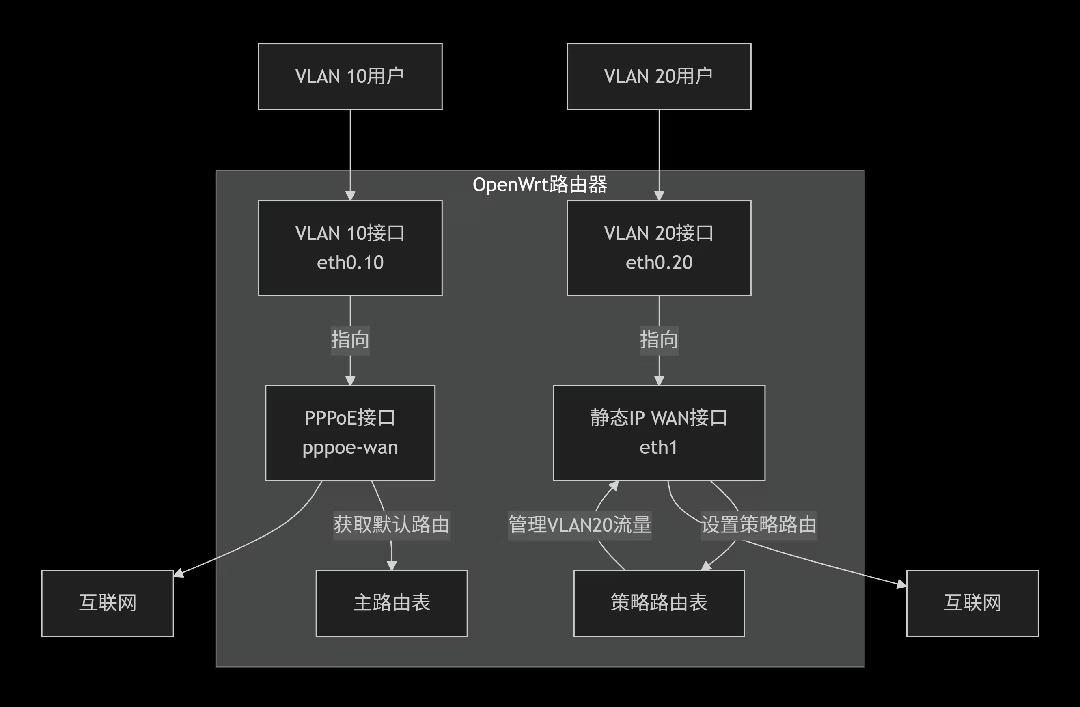

现在手头上有个刷好op的512m 兆能m2,想将pppoe和固定v4一起挂在兆能m2上,然后vlan10走pppoe,vlan20走固定v4。 问了ds,ds让我配置mwan3,但是实际配置后都实现不了想象中的效果,要么就是一起走pppoe,要么就是一起走固定v4。

在站里逛了逛,大多数帖子都是与PC、服务器、NAS等功能性系统产品有关,而少有关于电子测试测量仪器的帖子;既然是硬件相关论坛,没有测试测量仪器的有关讨论那怎么行?正好最近捡了一台多通道可调电源,跟各位分享一下心路历程;如果有什么问题,还请各位大佬不吝赐教!

事情是这样的:那天在深水鱼上面逛,看到了这台ITECH IT6322;看卖家描述,这台IT6322箱说全,就是库存的全新货,但是却开机黑屏,无法使用,打开发现有一颗电阻烧糊了;正巧我手头上只有一台开关电源,想攒一台鼎阳的SPD4323X,用作模拟,有纹波控制要求以及需要多路电源的电路调试,有时候调试维修,电路板需要两路或者三路直流电压输出,只有一台单通道直流电源就显得很尴尬,需要配一堆降压模块和额外接线;再加上艾德克斯的线性电源口碑不错,不少人评价甚高,早就想拥有一台,可惜财力不足。刚好碰上了这台IT6322,而且每天都在看各位大佬捡漏,早就心痒难耐,跃跃欲试了,刚好这台机子成色也相当不错,基本99新,于是便开始做功课,先看看这台机子究竟能不能修,值不值得赌这一波。