Qwen3 发布啦!

本次发布的模型包括:

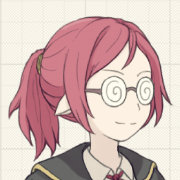

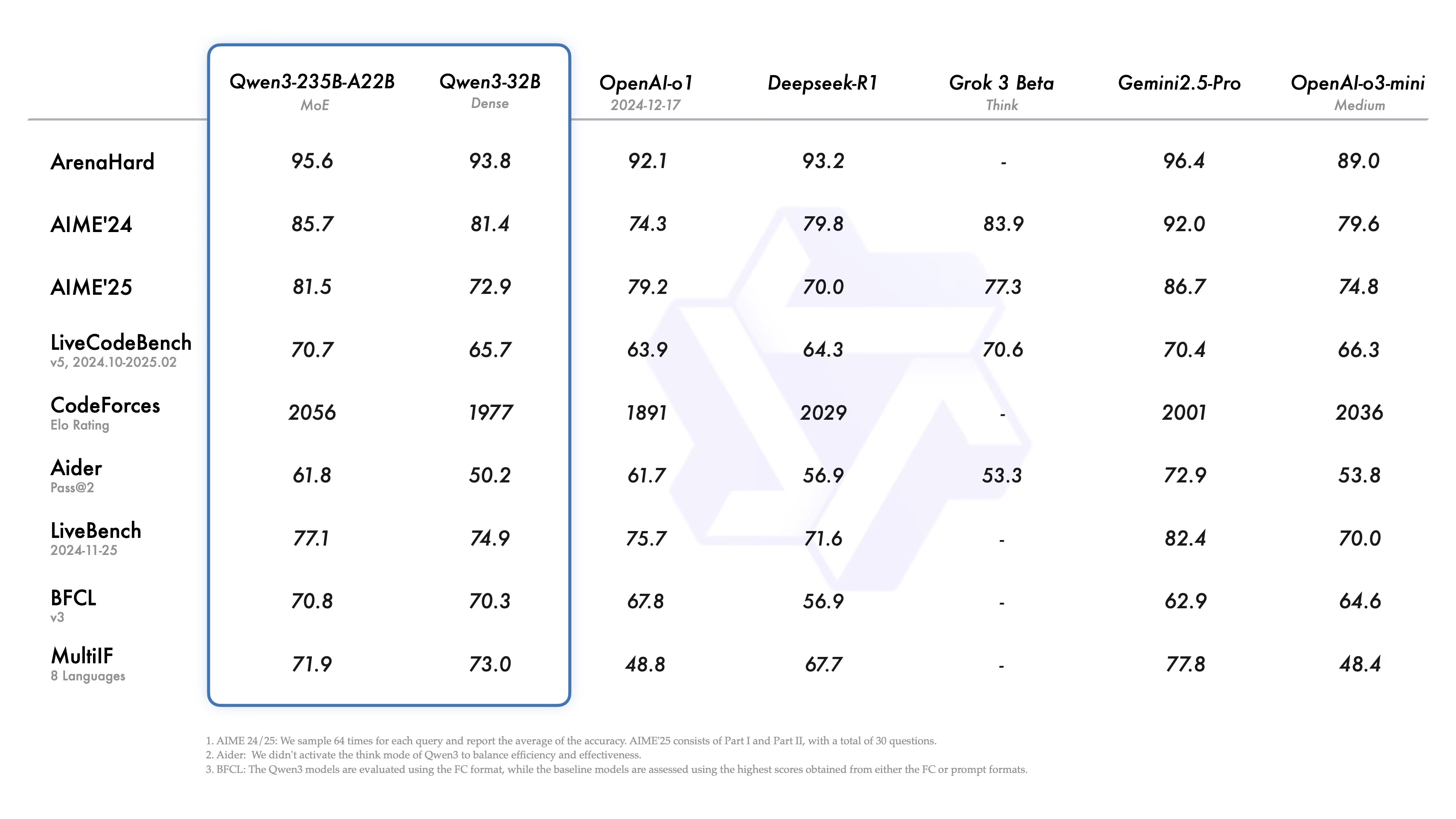

MoE 模型 Qwen3-235B-A22B (MoE, 总大小235B, 激活参数22B, 上下文128K) Qwen3-30B-A3B (MoE, 总大小30B, 激活参数3B, 上下文128K)

非 MoE 模型: Qwen3-32B Qwen3-14B Qwen3-8B Qwen3-4B Qwen3-1.7B Qwen3-0.6B

新版本的 Qwen3 特性如下:

- 混合思维模式, 搭载了 thinking 开关, 可以直接手动控制要不要开启 thinking

- 多语言支持, 支持 119 种语言和方言

- Agent 能力提升, 提升了编码和 Agent 方面的表现,并加强了 MCP 的支持

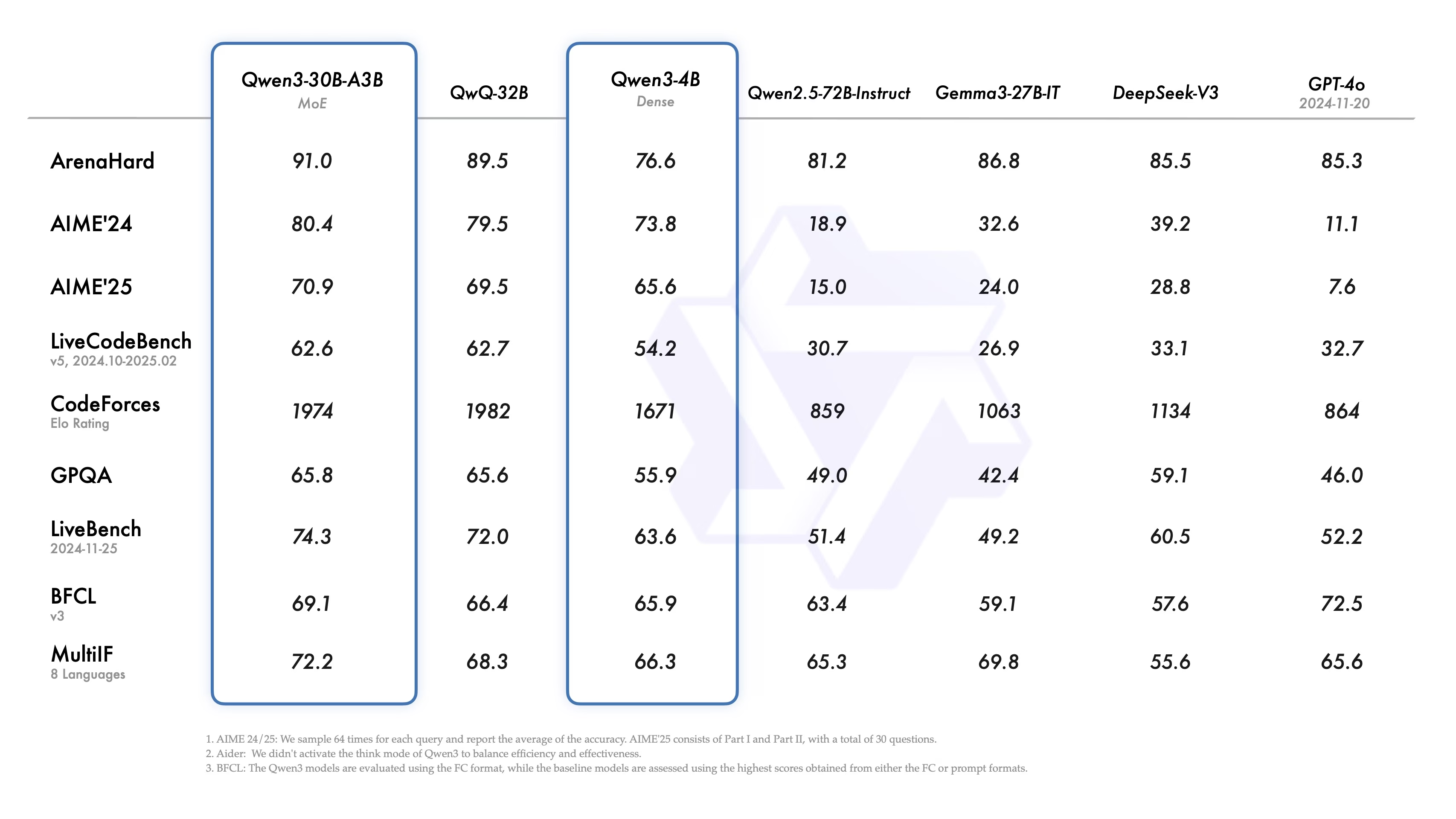

另外, chat.qwen.ai 的 Qwen3 也上线了啦!

技术报告地址: qwenlm.github.io/blog/qwen3/ 模型地址: modelscope.cn/collections/Qwen3-9743180bdc6b48 Github Repo: github.com/QwenLM/Qwen3

1

新特性有一定优势,但性能上限相比deepseek r1的提升比较小,与o4 mini还有较大差距。主要优势是30b版本上混合推理或预测解码,在主流配置能部署性能相当于deepseek r1的模型。