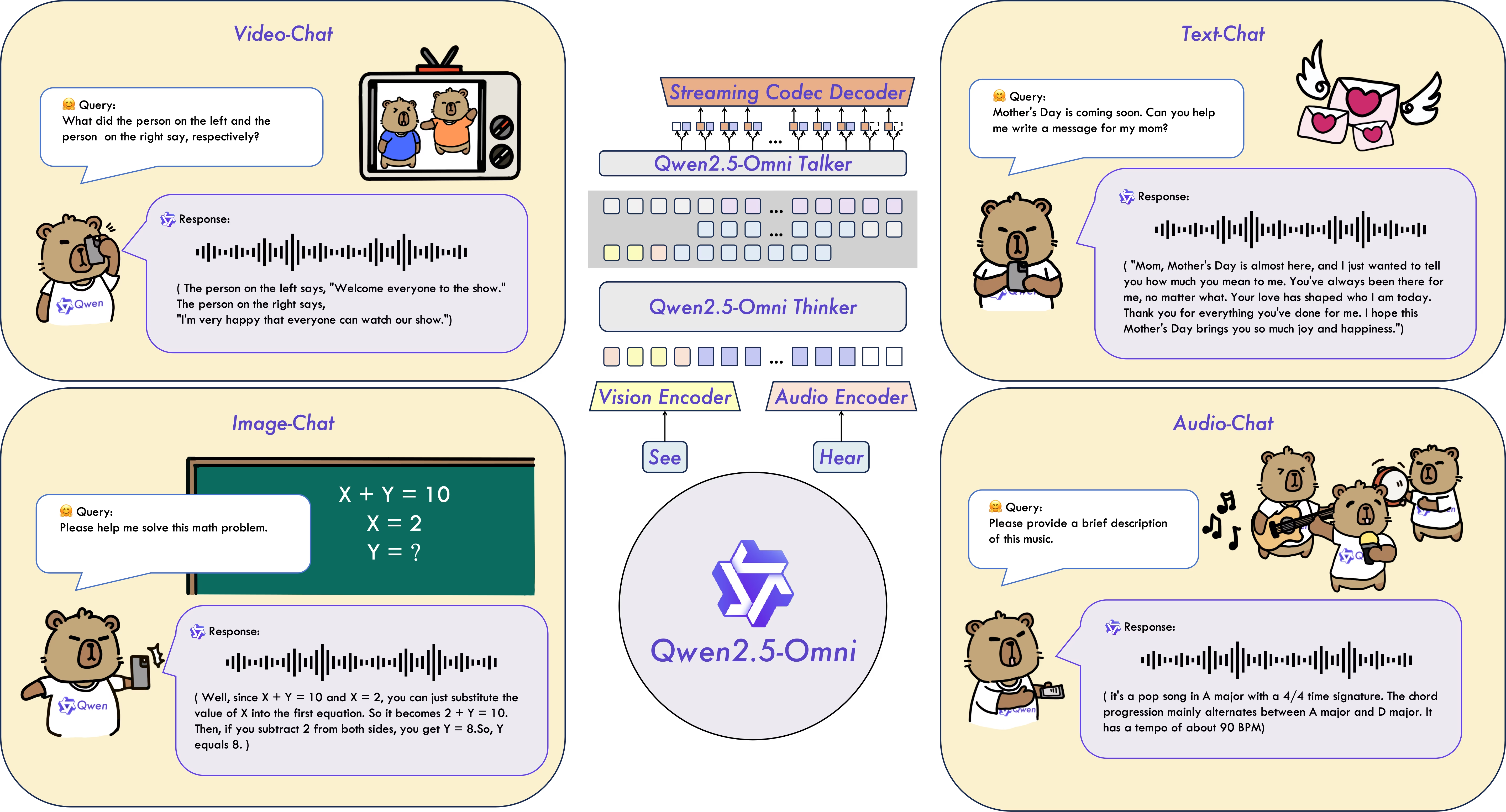

Qwen-2.5-Omni-7B 现在面临一个非常大的问题——目前还没有更普适的量化版本

现在量化版本只有 GPTQ,没有 gguf/mlx. 导致大部分使用 ollama, llama.cpp, mlx 的用户根本没办法用。而原版 7B 大小达到了20GB+,使用小显存显卡的用户完全没办法单卡部署。

而 GPTQ 量化理论上能用在 vLLM/SGLang 上。但是这俩框架目前也不支持。或者说这俩框架更多是为纯本文模型准备的。我看到 vLLM 里面提的支持 Qwen2.5-Omni-7B 的 PR 甚至都没有维护者回复…

随着时间流逝,现在 Qwen-2.5-Omni-7B 下载量也在下降了,这表示人们的关注度也在下降。建议官方看看能不能支持一波 gguf,给 llama.cpp 提个 PR 好让我们这些单卡佬用一用

1

llama.cpp现在都还没有开始引入asr/tts模型 🤣