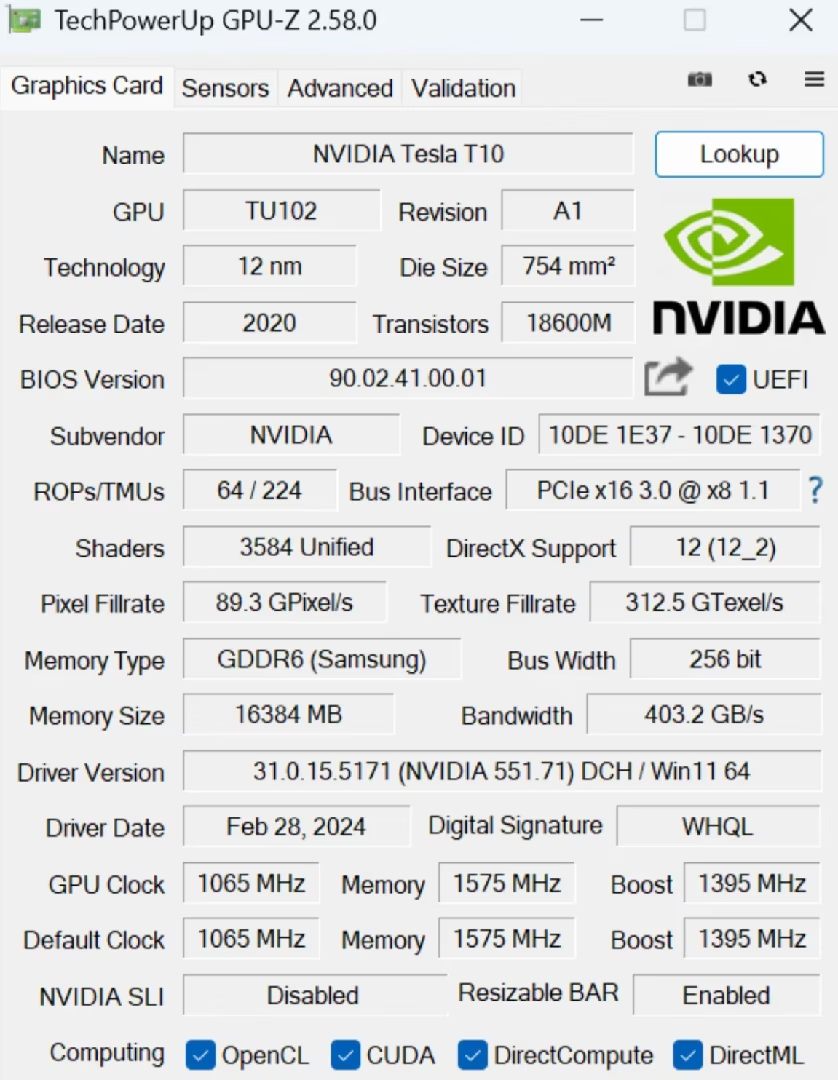

cuda graph这里没法跑,因为Turing架构没有BF16 参考: https://github.com/vllm-project/vllm/pull/29901#issuecomment-3668970227

Anthony-Hoo

买这个不如买魔改的3080 20G了,价格差不多2800,显存带宽和容量都高一截

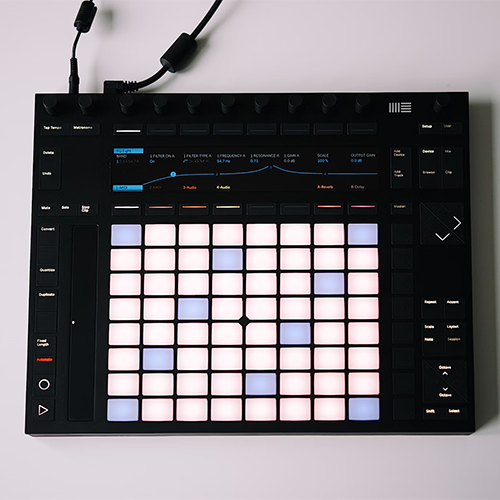

我用的启动命令是

VLLM_SLEEP_WHEN_IDLE=1 \ VLLM_USE_FLASHINFER_SAMPLER=1 \ OMP_NUM_THREADS=2 \ vllm serve ~/.cache/modelscope/hub/models/cpatonn-mirror/Qwen3-Next-80B-A3B-Instruct-AWQ-4bit \ --served-model-name Qwen3-Next-80B-A3B-Instruct-AWQ \ --quantization compressed-tensors \ --dtype float16 \ --gpu-memory-utilization 0.83 \ --max-model-len auto \ --max-num-seqs 32 \ --max-num-batched-tokens 2048 \ --tensor-parallel-size 4 \ --enable-prefix-caching \ --attention-backend FLASHINFER \ --tool-call-parser hermes \ --enable-auto-tool-choice \ --speculative-config '{"method": "qwen3_next_mtp", "num_speculative_tokens": 2}' \ --enforce-eager \ --host 0.0.0.0 \ --port 8100

是啊,不仅3槽起步,还超长+越肩 小机箱爱好者苦不堪言了

你发的模型1我也用过,当时试了下12038风扇得拉到5600RPM才能压住4卡满载不降频,真的直接起飞了。

另外,Qwen2.5-Coder-32B是 dense 模型,之前Qwen3还没发布的时候我跑过一阵子Qwen2.5-32B和Qwen2.5VL-32B。 现在对比下来,发现确实,4卡TP的时候 dense模型比现在主流的moe模型要发热更多。我猜可能moe引入了一些性能开销导致卡实际上吃不满?

btw这4卡跑Qwen3-30B-A3B-2507 W4A16的工况,–max-model-len可以开满256K,这个时候单并发生成速度有76tokens/s ,体感非常快。 但是感觉这个模型在上下文超过100K的时候召回就很不可用了,而且30B模型的能力确实不太行,后面还是换了Qwen3-Next-80B,配81920 tokens的上下文。

我一开始用的这个模型配的4CM磁浮暴力扇+调速器减速,1M噪音48dB的风力可以压住4卡满载150w烤机。

后面发现实际上跑vLLM TP的时候功率不高,32并发推理时平均单卡才60w不到,我就直接把整个机箱结构竖着放在空气净化器出风口了,静音高效还不用清灰 ☝️ 🤓

前言

同步发布于 我的Gist

这篇文初稿写于2025年3月,之前本来计划写好了直接发出来的,兜兜转转一直咕了,最近准备对这套配置做个升级,现在再不发出来就晚了。

现在来看,选T10性价比其实已经不是那么高,当时做这个配置的时候 2080ti 22G还要2200一块,现在已经跌到1700左右了,T10现在还在1000出头。 2080ti算力更高的同时还支持NVLink,4卡互联应该可以跑起来社区最近比较火的 MiniMax-M2.1-REAP W4A16。…

OpenAI卖token卖不过别人,不过他们面向一般客户的用户体验还是有些优势的,他们的模型研发团队和产品团队协作显然更好。 比如Gemini明明是1M上下文的模型,但是官网web页面输出超过100tokens之后就卡的不行。 Anthropic 的移动app在发起请求后必须保持在前台,否则断线即会终止回复。 Qwen的国内版app更是被阿里塞了一堆不知道啥玩意的狗皮膏药进去,搞得臃肿无比。

omni模型在本地跑的话,似乎可以做离线的语音翻译器,回头试试看。 手机的内存带宽还是瓶颈,也许他这个iOS版本在m系列的iPad上运行更快?

关于文心X1小球的那个,我这里测出来是这样的,最高分的代码多运行几次,有时候会出现2-3个小球 🤣

整理了下结果,已经pr了,需要把测试过程中生成的代码也附上吗

比较好奇这东西CPU能拉出来多少内存带宽,果子这边哪怕是M3Ultra,CPU部分也只有最大不到256GB/s的速度,要吃满800G得用GPU调用。

如果CPU带宽大的话也许HPC业务能从中受益

省流:这两个模型写代码效果较差,文心 4.5 略强于文心 X1。

| 测试项目 | 文心4.5 | 文心X1 |

|---|---|---|

| Ball Bouncing Inside Spinning Heptagon | 23 | 51 |

| Mandelbrot Set Meet LiBai | 52 | 0 |

| Mars Mission Animation | 26 | 39 |

| Solar System Animation | 78 | 38 |

会不会像mac pro里面的m2 ultra类似的封装,内存颗粒在顶盖下

打开ihs之后其实是这样的

看起来原始机型似乎是ThinkPad L13 Yoga Gen 3 AMD版,C面的摄像头是翻转之后平板模式下当后摄用的。 参考: https://www.lenovo.com/us/en/p/laptops/thinkpad/thinkpadl/thinkpad-l13-yoga-gen-3-13-inch-amd/len101t0034