速报——智谱好像要发 GLM4

看上去模型大小分32B和9B,然后不同参数量大小还有衍生模型,比如 GLM-4-32B-0414 是基座模型,GLM-4-32B-Chat-0414 是 Chat 模型,GLM-Z1-32B-0414 是思考模型,GLM-4-Z1-Rumination-32B-0414 (Rumination 反刍/沉思?不知道是不是前几天那个沉思),GLM-4V-9B 视觉多模态。

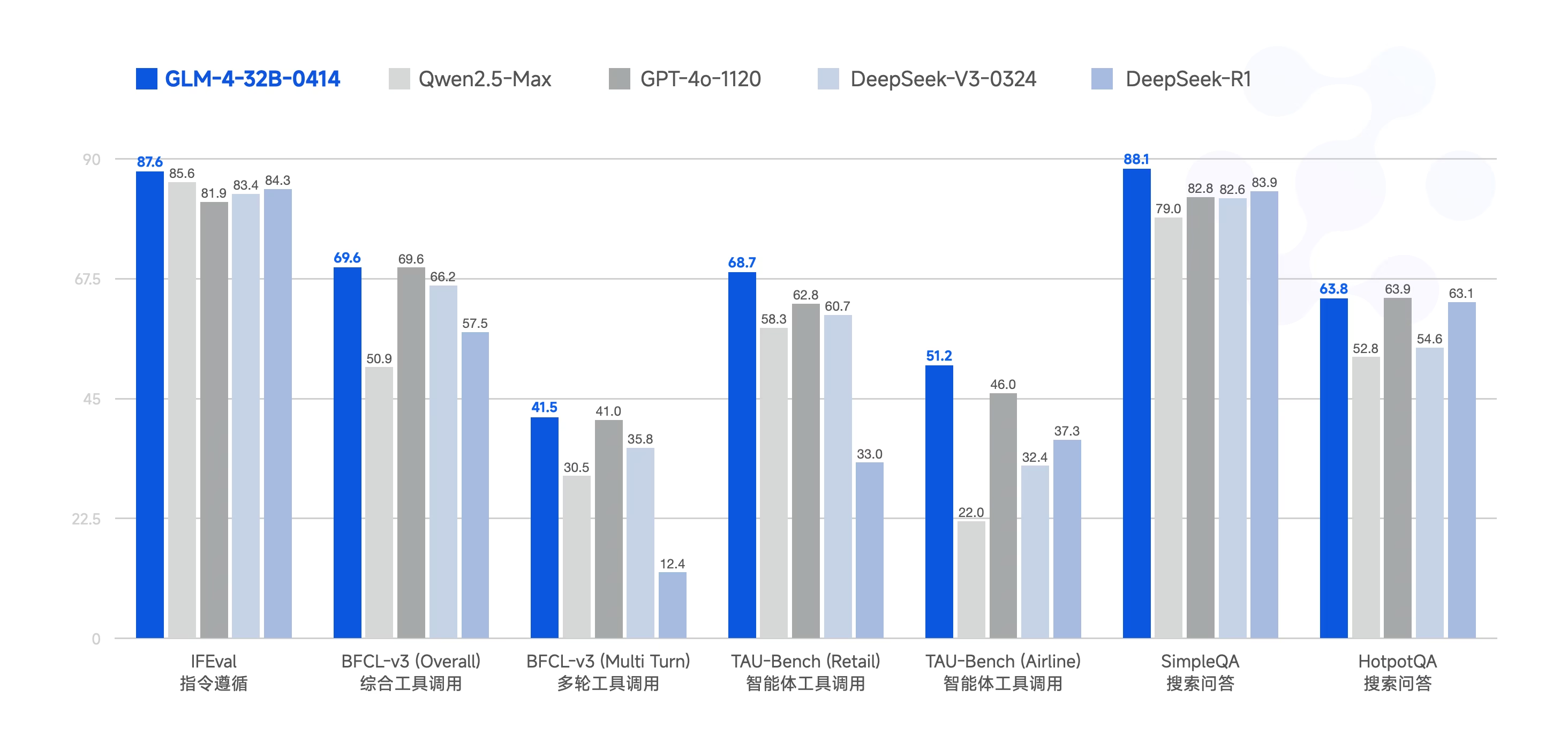

从分数上来看 GLM-4-32B-0414 比 DeepSeek-V3-0324 和 DeepSeek-R1 都高。而且只是个32B模型!

目前能看到的这个页面应该是智谱的研究员的账号?以及推理引擎的支持 transformers/vllm/llama.cpp 的 GLM-4 支持都已经合并了。

一旦放出,KCORES 大模型竞技场将第一时间为大家带来测评!

0