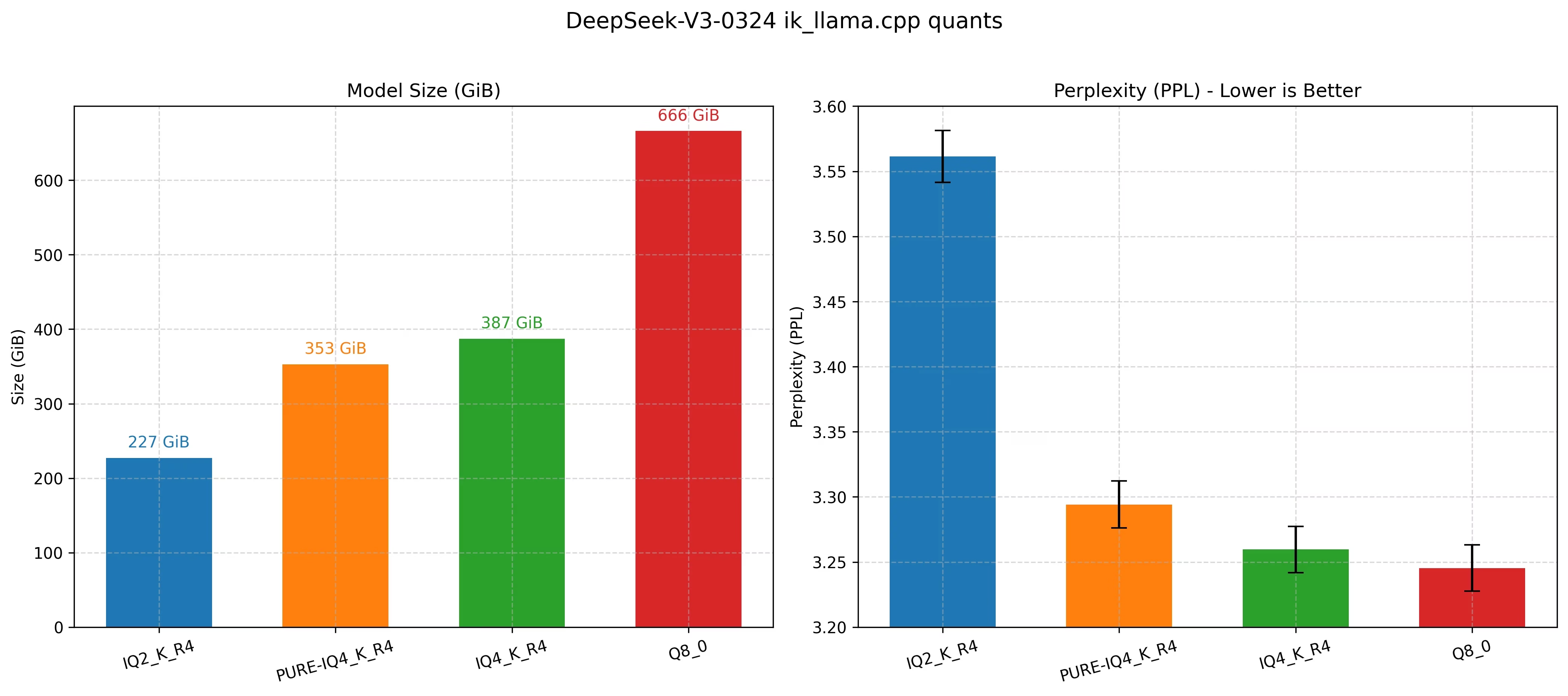

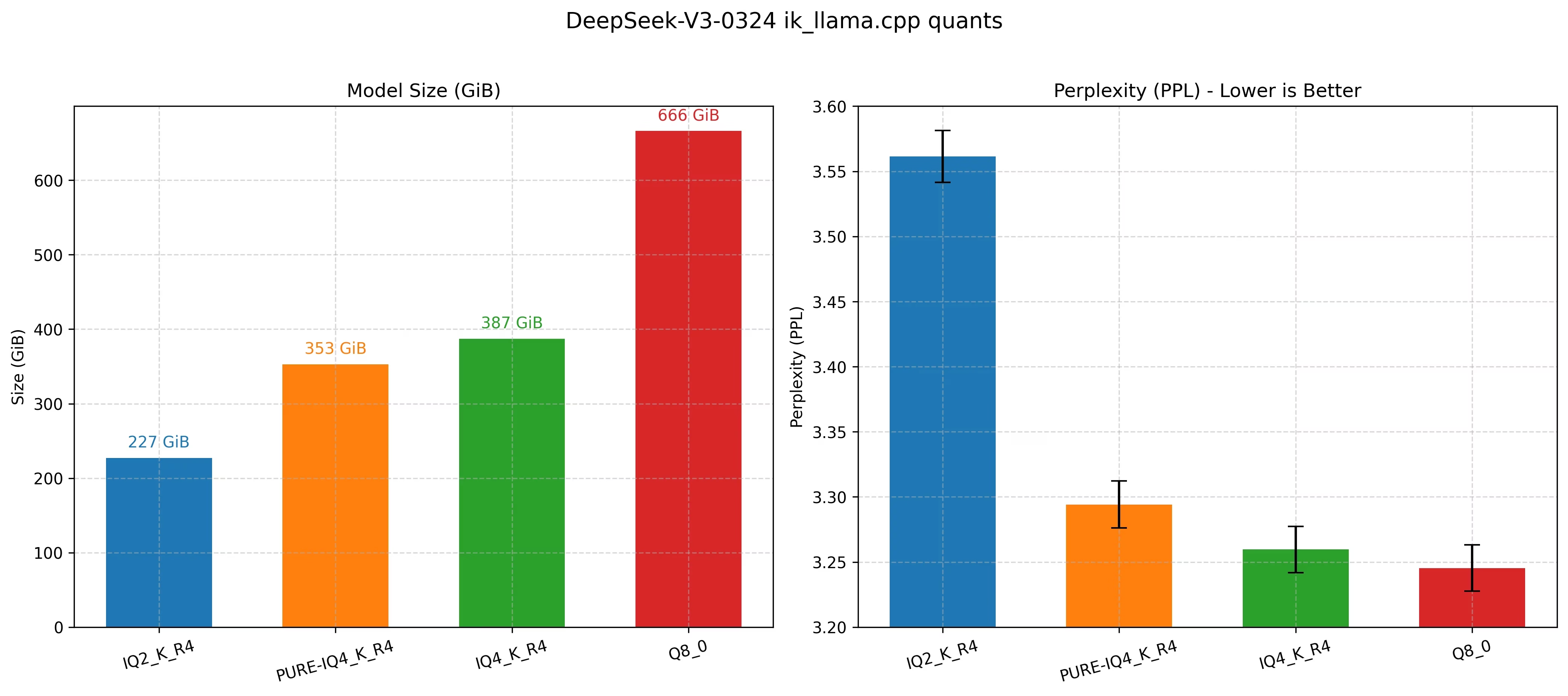

ubergarm 发布了一个他们的 DeepSeek-V3-0324 量化,这个量化版本搭配他们定制的 llama.cpp 性能特别强:

IQ4量化,单个 Intel 至强 6980P CPU 能达到 8.5 token/s, 同时保持良好的困惑度

量化模型地址:huggingface.co/ubergarm/DeepSeek-V3-0324-GGUF 需要的定制版 ik_llama.cpp 地址:github.com/ikawrakow/ik_llama.cpp/

0

ubergarm 发布了一个他们的 DeepSeek-V3-0324 量化,这个量化版本搭配他们定制的 llama.cpp 性能特别强:

IQ4量化,单个 Intel 至强 6980P CPU 能达到 8.5 token/s, 同时保持良好的困惑度

量化模型地址:huggingface.co/ubergarm/DeepSeek-V3-0324-GGUF 需要的定制版 ik_llama.cpp 地址:github.com/ikawrakow/ik_llama.cpp/