inceptionlabs 刚刚推出了一个全新架构的大模型 Mercury (水星)。这个不是传统意义上的transformer架构,而是diffusion架构。具体来讲是基于扩散过程(噪声逐步去除)通过迭代去噪生成文本,而且迭代可以并行,因此速度很快。

快到什么程度呢?官方宣称H100上每秒能生成1000+token。

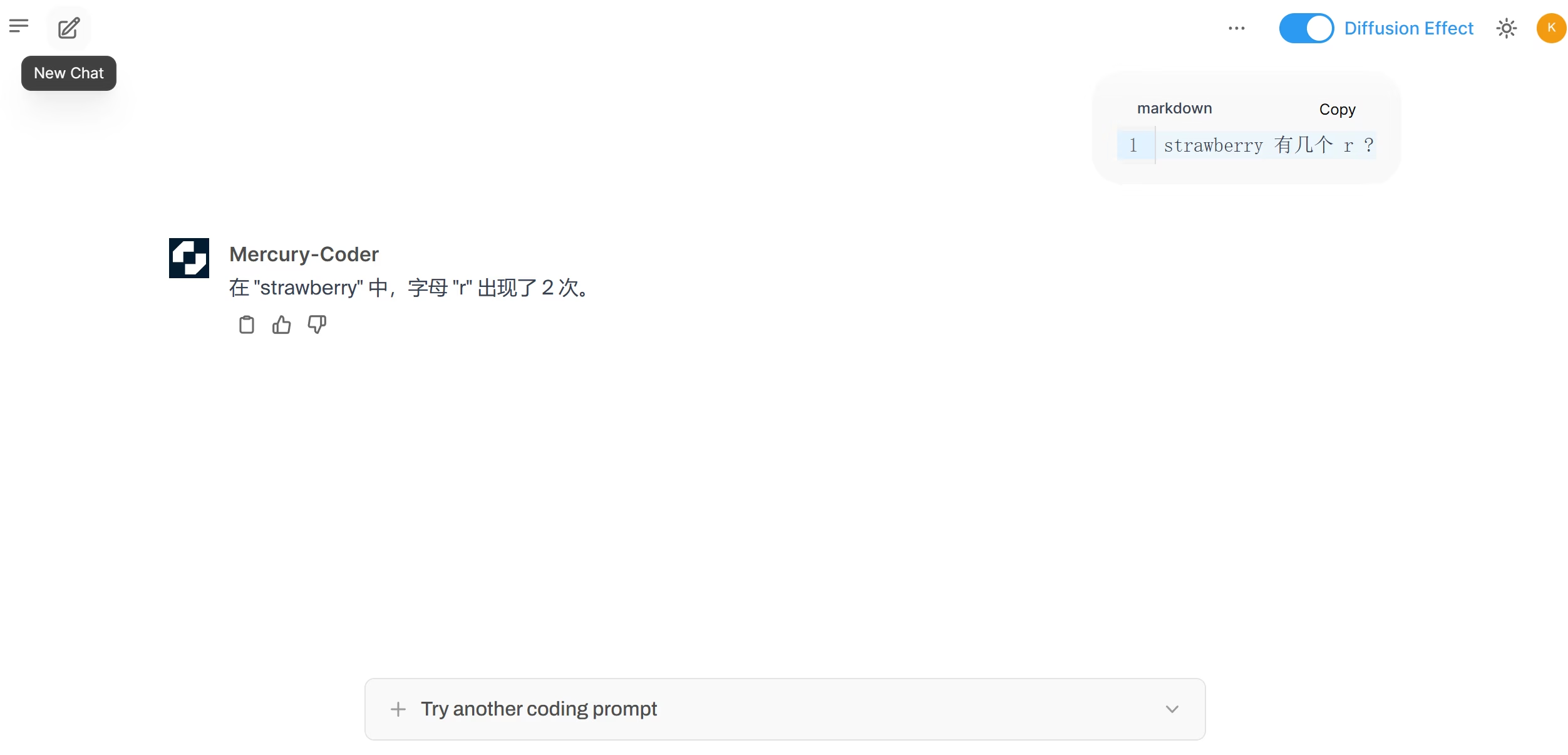

变天了?没有,虽然快,但是效果就…(见图1)

官方放出了Mercury-Coder,感兴趣的同学可以去试一试:chat.inceptionlabs.ai

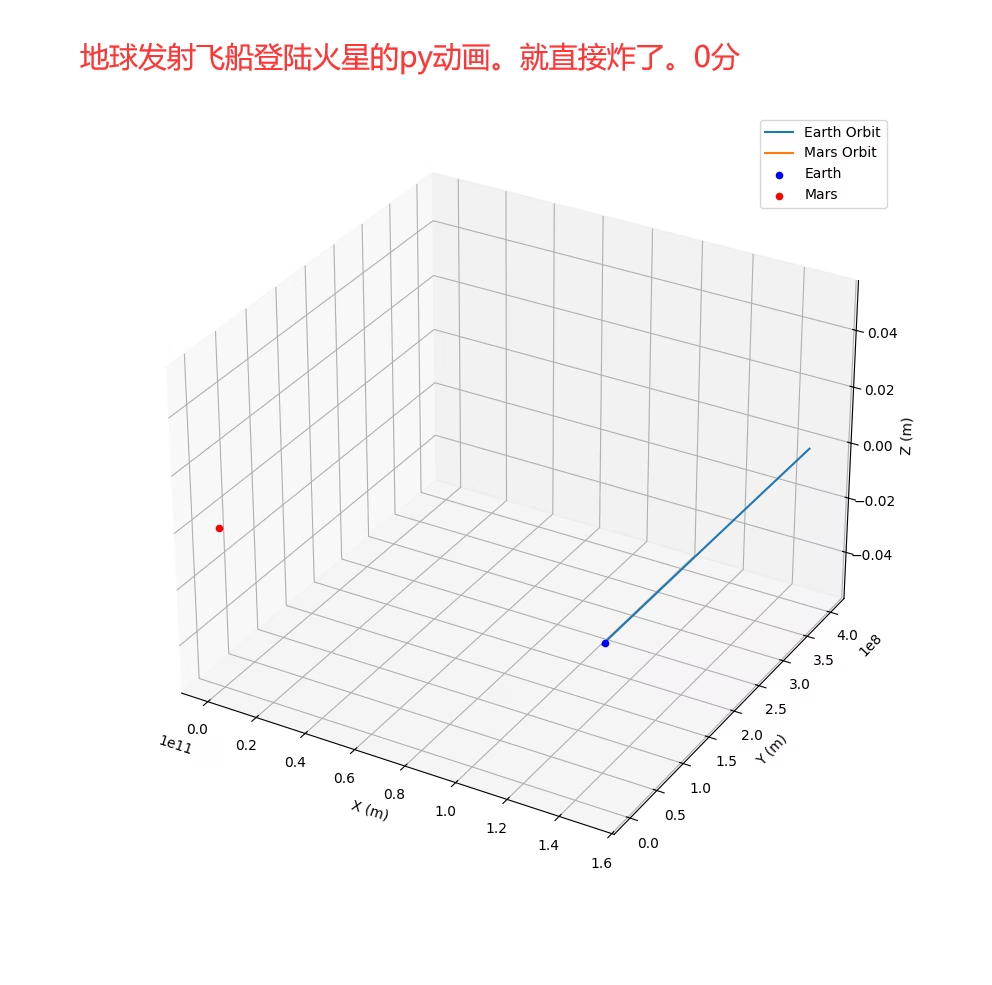

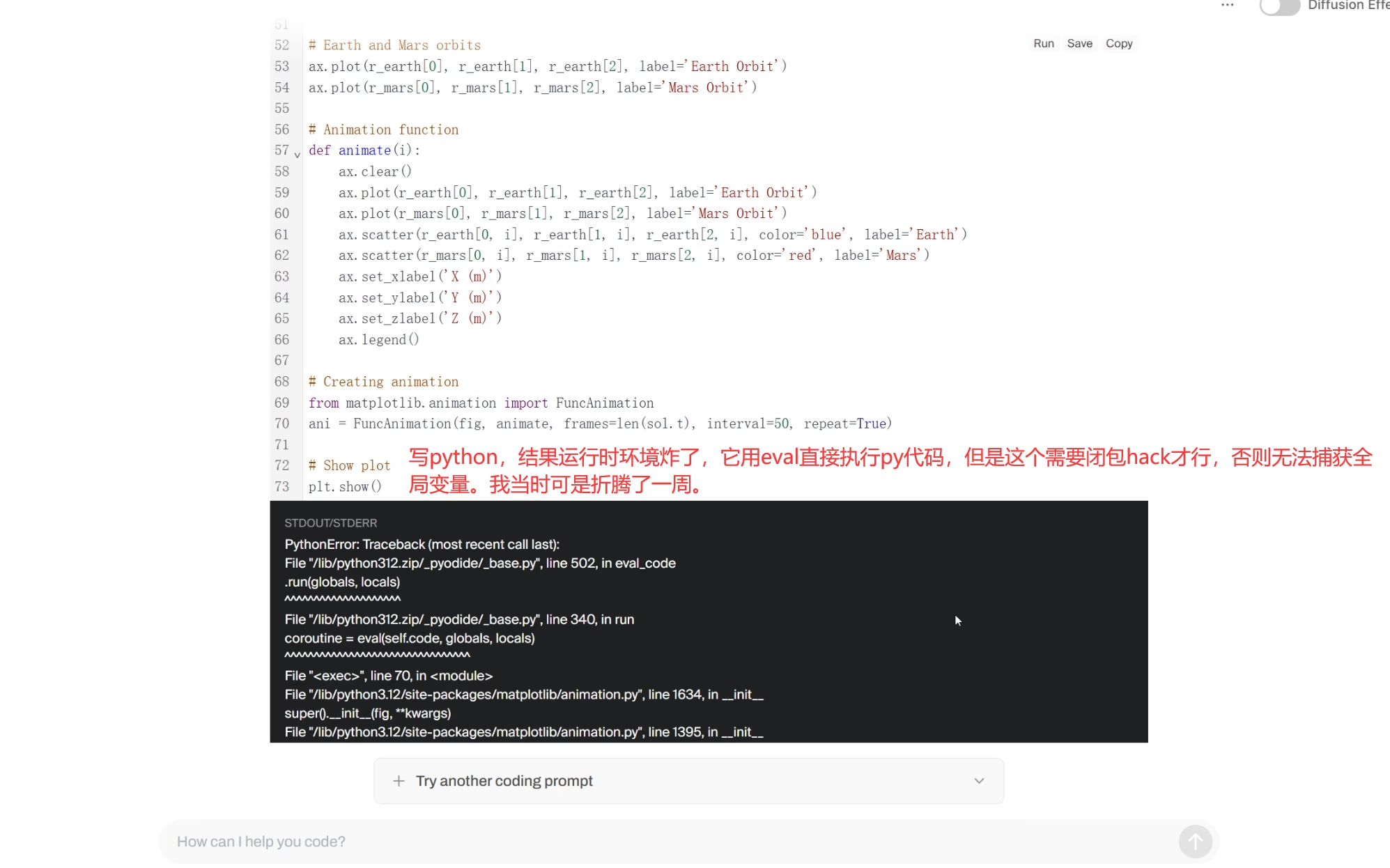

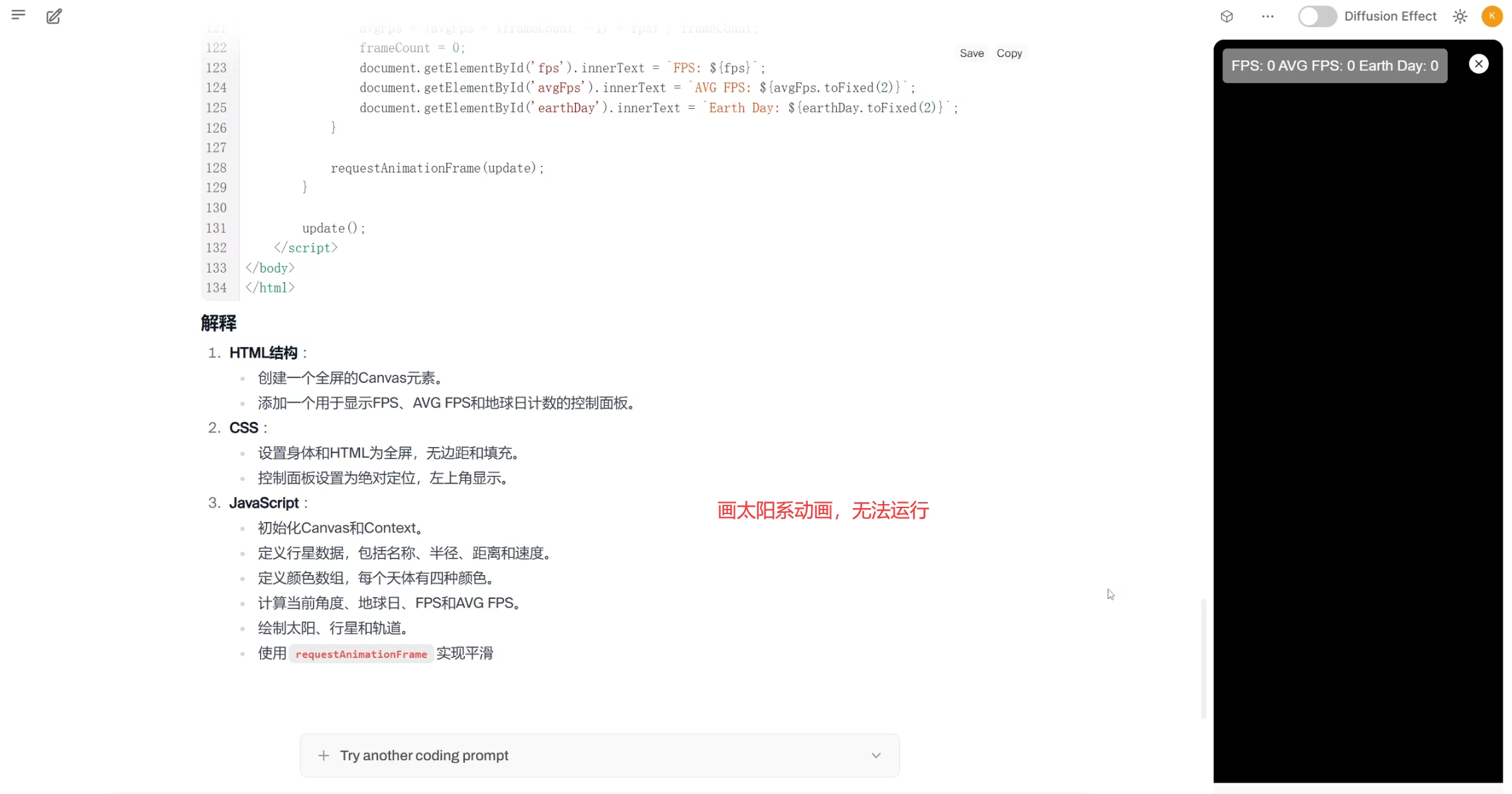

我测试了几个写代码的例子,后面几个截图都是。评价是,不如GPT4-mini. 建议持续观望,毕竟diffusion的确比transformer快。但是效果还是差点事。

0