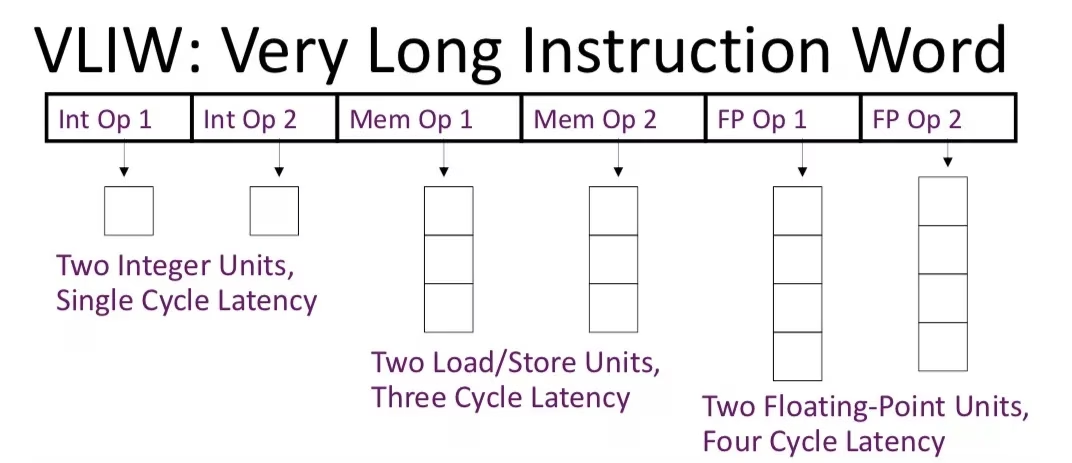

A佬 @AlphaArea 刚分享给我一篇写的非常好的文。论证了Groq(不是Grok)使用VLIW做AI算力卡,是如何作死炸了的。分享给大家。

这篇文:VLIW的傻〇编译器他们自家公司搞了好几天提升3%性能… A佬:指望用超大SRAM打HBM本身就已经抽象过头了 我:VLIW流水线冲刷就够所有大厂喝一壶的了

某些NPU也是VLIW的。大家知道为啥没人用NPU了吧[苦涩]

(甲骨文:我最有发言权了!我最有发言权了!)

地址:irrationalanalysis.substack.com/p/very-long-incoherent-writeup

3